你的数据,真的被有效“喂”进去了?

当一套大模型训练任务启动,数千张GPU同时运转,算力的轰鸣声背后,其实隐藏着另一个更为关键的问题——数据,能否稳定、持续、高效地被“喂”进去。

在智能时代,存储不再只是后台资源。它决定着模型训练是否顺畅,决定着GPU利用率是否被浪费,甚至决定着智能技术能否按期落地。

也正是在这样的现实考验下,戴尔PowerScale的价值再次凸显。

它不是因为智能而出现。

却在智能时代,再次成为行业焦点。

一种经得起规模验证的架构逻辑

PowerScale之所以能够在智能时代继续领先,并非源于针对智能技术做了短期优化,而是源于其长期坚持的架构理念。

自诞生之初,PowerScale便围绕一个核心命题持续演练:

当非结构化数据规模不断增长时,如何让性能与容量同步扩展,而不引入复杂架构重构。

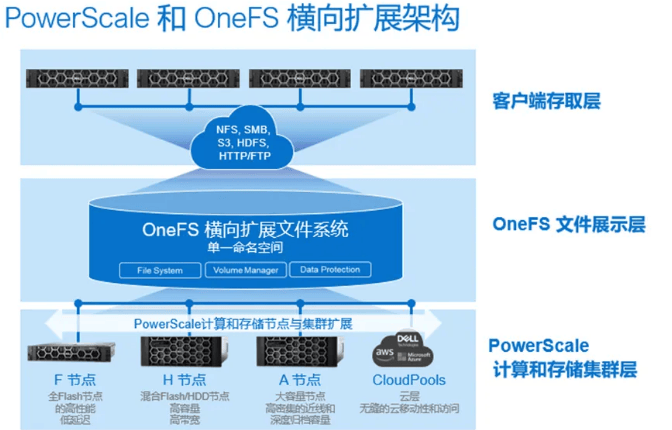

基于OneFS统一文件系统,PowerScale采用横向扩展架构。每一个节点同时提供存储、计算与网络能力,在统一命名空间下协同运行。

随着节点增加,集群的容量与性能实现同步扩展。单一PowerScale集群可扩展至最多252个节点,原始容量可达百PB级规模(视节点型号组合而定)。扩展过程中支持在线加入节点,无需中断业务运行。

这种能力在传统数据增长阶段已经被充分验证。而当智能应用进入规模化生产阶段,其意义变得更加直接——

从小规模试点到大规模模型训练,企业无需重构底层架构,系统可以自然扩展。架构本身具备自然“生长能力”,而非阶段性替换能力。

这也是PowerScale能够长期位居横向扩展NAS市场领导地位的根本原因。

当数据流动效率决定算力价值

在智能训练环境中,存储系统的价值往往体现在一个简单却关键的问题上:GPU能否持续获得稳定的数据吞吐。

而PowerScale在统一文件平台上支持NFS、SMB以及S3兼容访问能力,使文件与对象数据能够在同一架构中并存。这对于承载多类型数据负载、支撑不同阶段的智能工作流尤为重要。

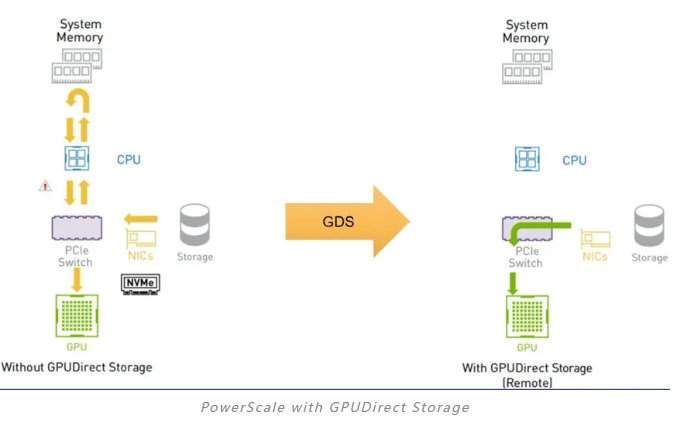

在数据路径层面,PowerScale支持GPUDirect Storage以及NFSoRDMA等技术。通过减少数据在网络与系统中的中间跳转环节,缩短GPU与存储之间的数据路径,从而提升整体训练效率。

这并非单纯追求某一IO峰值指标,而是围绕整体数据流动效率进行的系统级优化。

在实际部署方面,PowerScale已在全球大量企业环境中承载关键数据资产,并在众多GPU负载场景中落地应用。其成熟度不仅体现在技术能力上,更体现在规模化生产环境中的持续验证。

行业评价同样印证了这一趋势。

面向未来的持续演进能力

智能时代,基础设施建设并不是一次性投入。模型在进化,数据在增长,硬件在迭代——真正可持续的基础设施,必须具备长期演进能力。

PowerScale支持在线升级与节点混合部署,新旧节点可以在同一集群中共存运行。同时,OneFS系统支持平滑升级,业务无需中断。这种架构设计,使企业能够在扩展容量与性能的同时,依然保持既有投资的连续性,而非阶段性推倒重来。

这种能力并非“额外附加”,而是横向扩展架构的自然结果——统一命名空间与分布式数据布局,使硬件更替成为平滑过程,而不是系统性重构。

在行业层面,这种长期稳定性与持续创新能力也获得权威认可。

在2025年Gartner®企业存储平台魔力象限™报告中,戴尔科技被评为“领导者”。该报告从产品能力与市场执行力等多个维度进行综合评估,是企业级存储领域具有广泛影响力的分析之一。PowerScale作为戴尔企业级存储产品组合的重要组成部分,正是这一能力体系的核心代表。

领导力的延续,并非阶段性爆发

从非结构化数据爆发,到智能算力时代到来,技术周期在变化。但真正决定长期价值的,往往是架构是否具备跨周期能力。PowerScale在大数据时代建立领导地位,并非偶然——它解决的是“规模如何优雅扩展”的问题。

而在智能时代,这一问题变得更加重要——

当GPU规模扩大,当模型参数持续增长,当数据边界不断突破……底层架构是否能够线性扩展、持续供给、稳定运行,直接决定智能项目的效率与可持续性。

当算力成为战略资源,数据供给能力同样成为核心竞争力。PowerScale并没有因为智能时代而重新定义自己,它所坚持的架构逻辑,本身就是智能时代所需要的能力。